| Guion |

ChatGPT, Claude |

Ollama + modelos locales |

Mantenga un guión breve y amigable para el lenguaje hablado. |

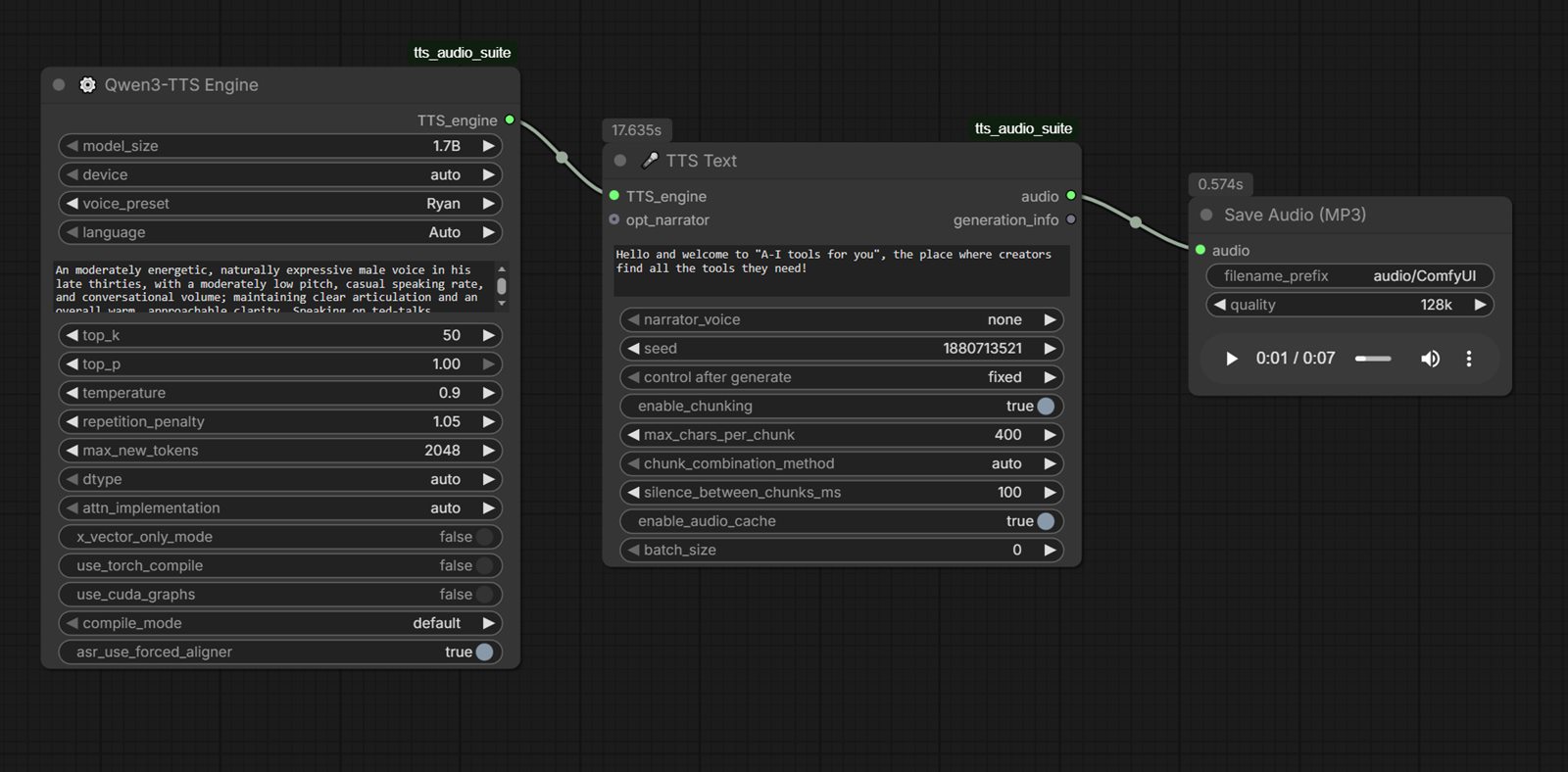

| Voz |

ElevenLabs, Murf |

Piper TTS, Coqui TTS, Kokoro TTS, ComfyUI TTS |

Normalice el volumen antes de la generación del avatar. |

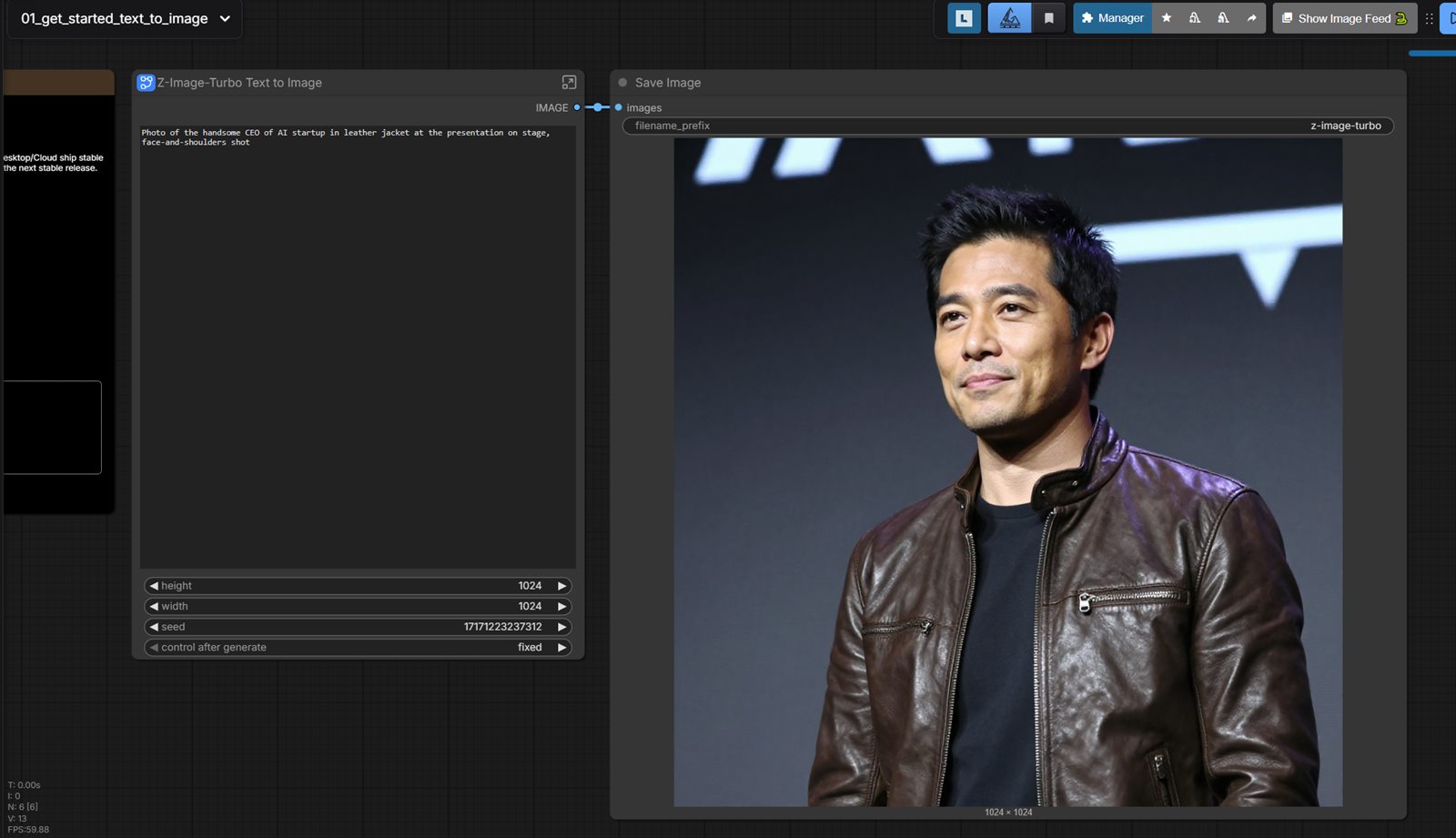

| Creación de cara de avatar |

Midjourney, Leonardo AI, Adobe Firefly |

ComfyUI, Fooocus, AUTOMATIC1111 |

Genere retratos frontales con luz limpia para obtener mejores resultados de sincronización de labios. |

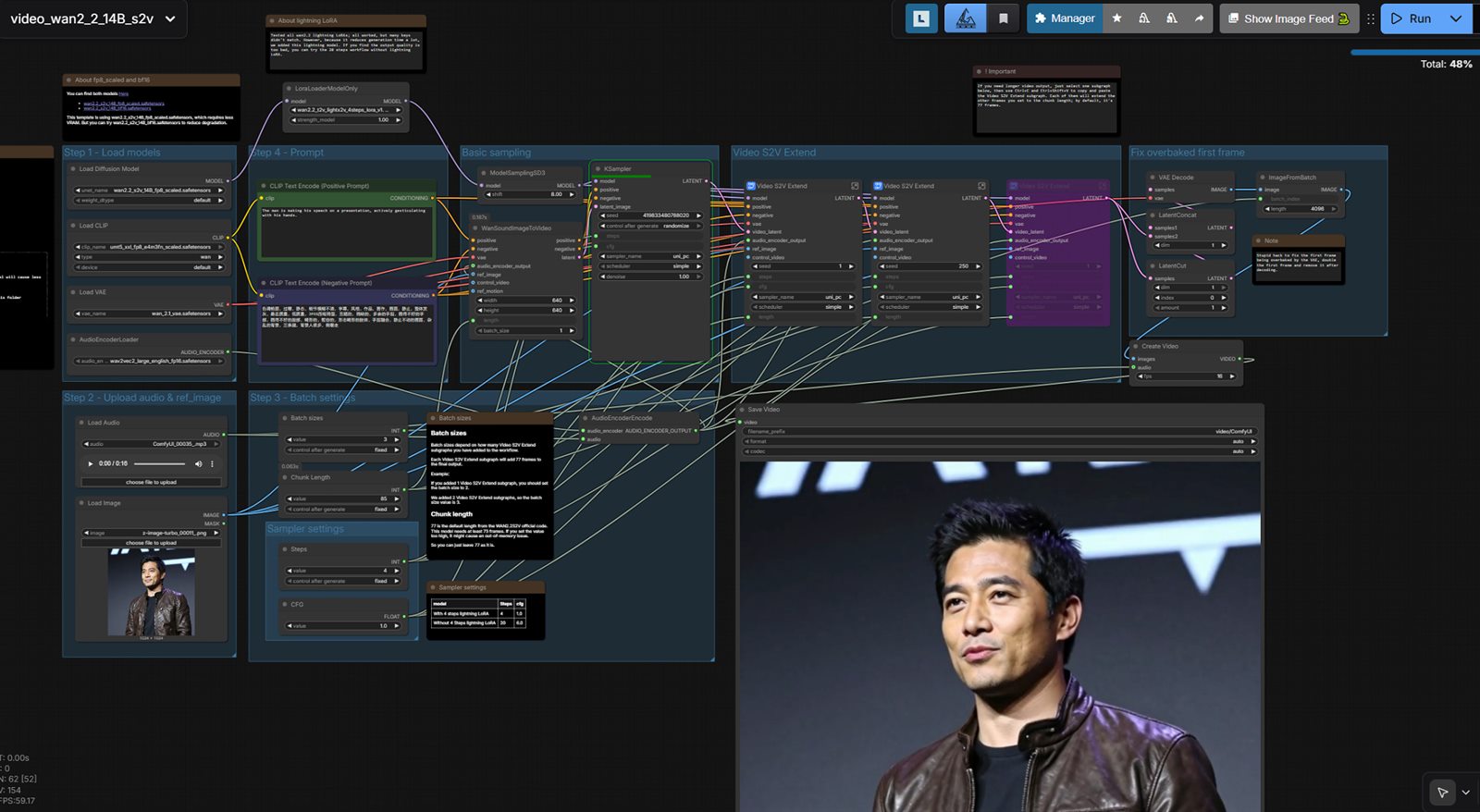

| Avatar |

HeyGen, Síntesis, D-ID, Tavus |

LivePortrait, SadTalker, flujos de trabajo ComfyUI |

Utilice retratos de fuente limpia y encuadres neutros. |

| Editar |

Descript, VEED, CapCut |

DaVinci Resolve + herramientas de subtítulos locales |

Recorta el aire muerto y agrega transiciones de escenas. |