-

Drehbuch und Drehplan schreiben

Ein kurzes, gesprochenes Drehbuch, aufgeteilt in Szenen (Hook, Body, CTA).

So geht's:

- Definieren Sie einen Zielpublikum und eine gewünschte Aktion (Folgen, Klicken, Kommentieren, Kaufen).

- Schreiben Sie ein 20–60 Sekunden langes Skript in gesprochener Sprache, nicht im Blog-Stil.

- Teilen Sie das Skript in Szenenblöcke auf: Hook (0–3 Sekunden), Wert (3–20 Sekunden), CTA (letzte 3–5 Sekunden).

- Erstellen Sie eine Shot-Liste, die jede Zeile einem visuellen Hintergrund oder einem B-Roll-Cue zuordnet.

Qualitätsprüfungen:

- Lesen Sie es einmal laut vor. Entfernen Sie unnatürlich klingende Zeilen.

- Behalten Sie eine Idee pro Satz bei; Vermeiden Sie lange Phrasen mit mehreren Sätzen.

- Zielen Sie auf ein entsprechendes Tempo von 120–160 Wörtern pro Minute.

Werkzeuge:

ChatGPT

,

Claude

-

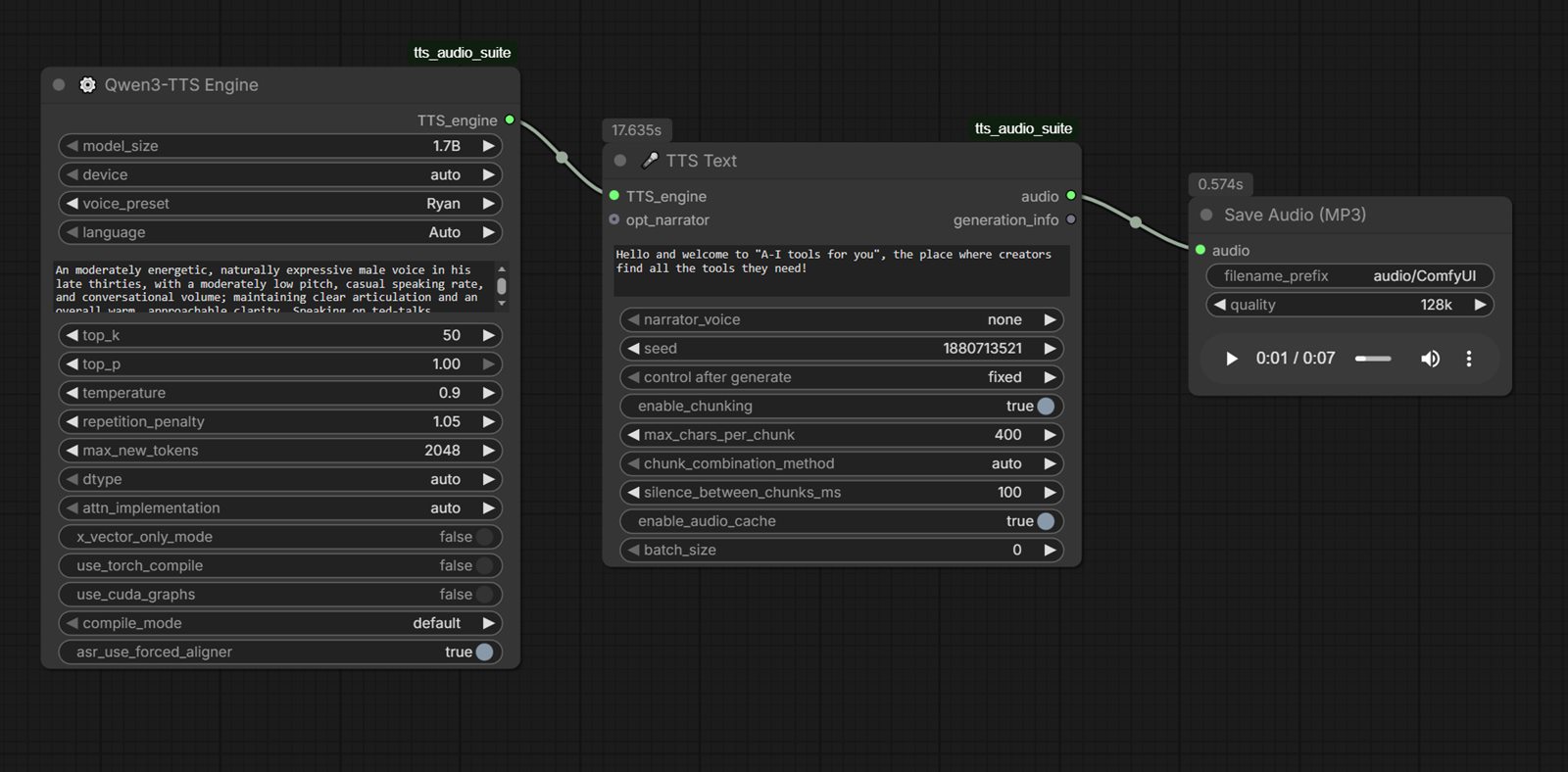

Erstellen oder wählen Sie eine Stimme aus

Natürliche Erzählstimme (Standard oder geklont), abgestimmt auf den Markenton.

So geht's:

- Wählen Sie das Sprachprofil nach Zielgruppe: maßgeblich, freundlich, lehrreich oder verkaufsfördernd.

- Erzeugen Sie die Stimme in kurzen Abschnitten (1–2 Sätze), um die Wiederholung zu erleichtern.

- Passen Sie Geschwindigkeit, Stabilität und Stil an, bis die Aussprache konsistent ist.

- Exportieren Sie sauberes WAV/MP3 ohne Hintergrundmusik.

Qualitätsprüfungen:

- Normalisieren Sie die Lautstärke vor der Avatar-Generierung auf ein einheitliches Niveau.

- Korrigieren Sie Namen/Marken mit phonetischer Schreibweise, wenn sie falsch ausgesprochen werden.

- Achten Sie bei langen Sätzen auf den Roboterrhythmus und teilen Sie ihn bei Bedarf auf.

Werkzeuge:

ElevenLabs ,

Murf

,

Piper TTS (lokal)

,

ComfyUI TTS (lokal)

-

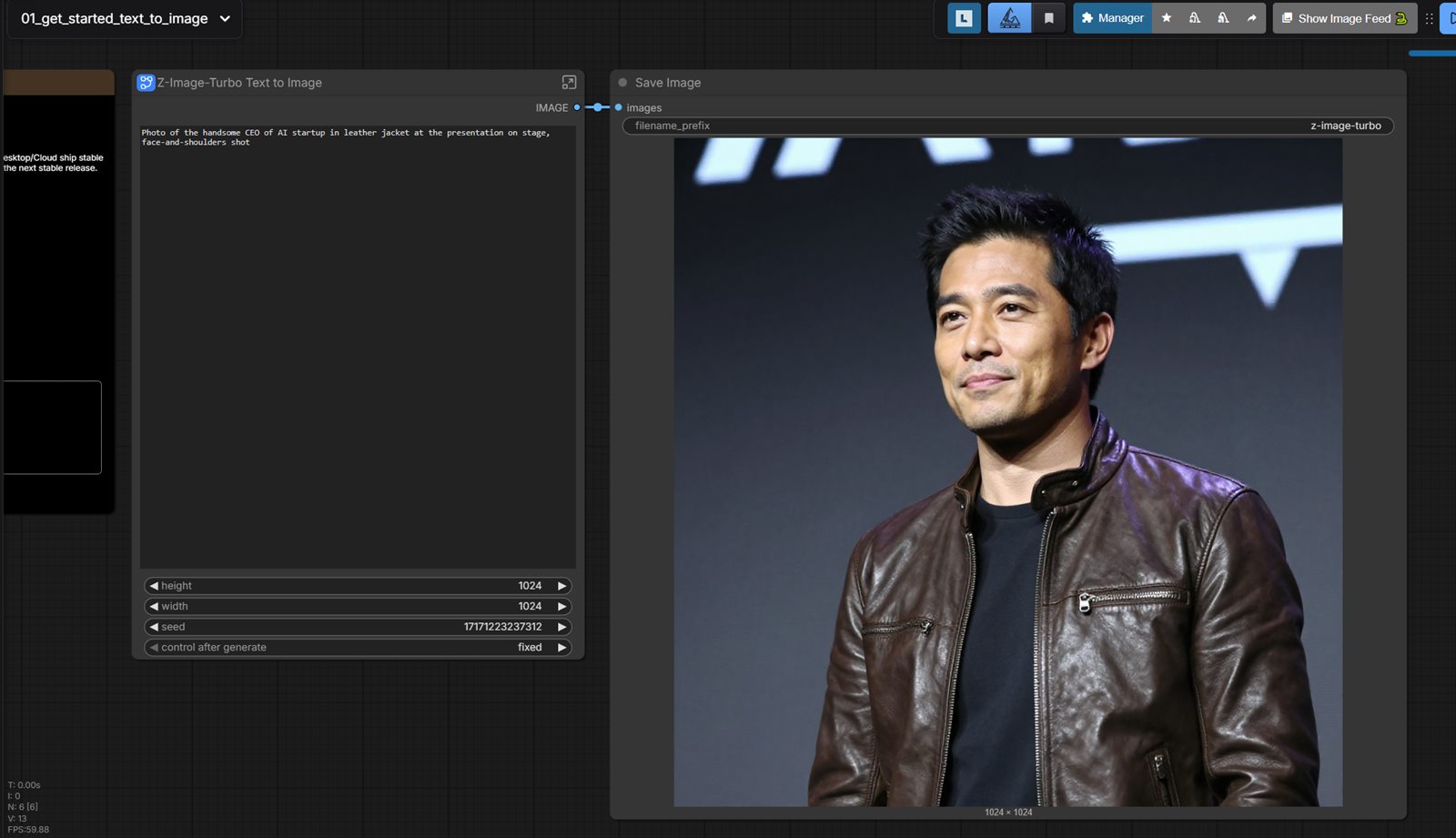

Erstellen Sie ein Avatar-Gesicht/eine Avatar-Figur

Ein sauberes Porträt-/Charakterbild, um sprechende Animationen voranzutreiben.

So geht's:

- Erstellen Sie ein nach vorne gerichtetes Porträt mit neutralem Gesichtsausdruck und klarer Kinnpartie.

- Verwenden Sie einen einfachen Hintergrund und eine gleichmäßige Beleuchtung für eine bessere Lippen- und Kinnverfolgung.

- Erstellen Sie 3–5 Varianten und wählen Sie eine mit der besten Gesichtssymmetrie und Augenklarheit aus.

- Exportieren Sie ein hochauflösendes Bild (mindestens 1024 Pixel auf der kürzesten Seite).

Qualitätsprüfungen:

- Vermeiden Sie starke Seitenwinkel, Sonnenbrillen oder Haare, die den Mund bedecken.

- Vermeiden Sie extreme Stilisierungen, die den Lippen- und Zahnbereich verzerren.

- Sorgen Sie dafür, dass das Aussehen Ihres Avatars mit der Marke Ihres Kanals übereinstimmt.

Werkzeuge:

Midjourney ,

Leonardo AI ,

Adobe Firefly

,

ComfyUI (lokal)

-

Erzeugen Sie ein sprechendes Avatar-Video

Lippensynchronisierter Avatar, der Ihr Skript/Audio spricht.

So geht's:

- Laden Sie die endgültige Sprachspur und das ausgewählte Gesichtsbild in den Avatar-Generator hoch.

- Stellen Sie den Rahmen (Kopffreiheit, Schulterausschnitt, Augenlinie) für das Plattformformat ein.

- Rendern Sie zuerst einen kurzen Testclip (5–10 Sekunden) und dann das vollständige Skript.

- Wenn die Lippensynchronisation abweicht, rendern Sie den Text mit kürzeren Satzteilen erneut.

Qualitätsprüfungen:

- Überprüfen Sie den Mundschluss bei harten Konsonanten (P/B/M) und langen Vokalen.

- Überprüfen Sie die Blinzelfrequenz und die Augenbewegung auf unnatürliche Artefakte.

- Lehnen Sie Ausgaben mit offensichtlichem Chin-Jitter oder Frame-Warping ab.

Werkzeuge:

HeyGen

,

Synthesia ,

D-ID ,

Tavus

-

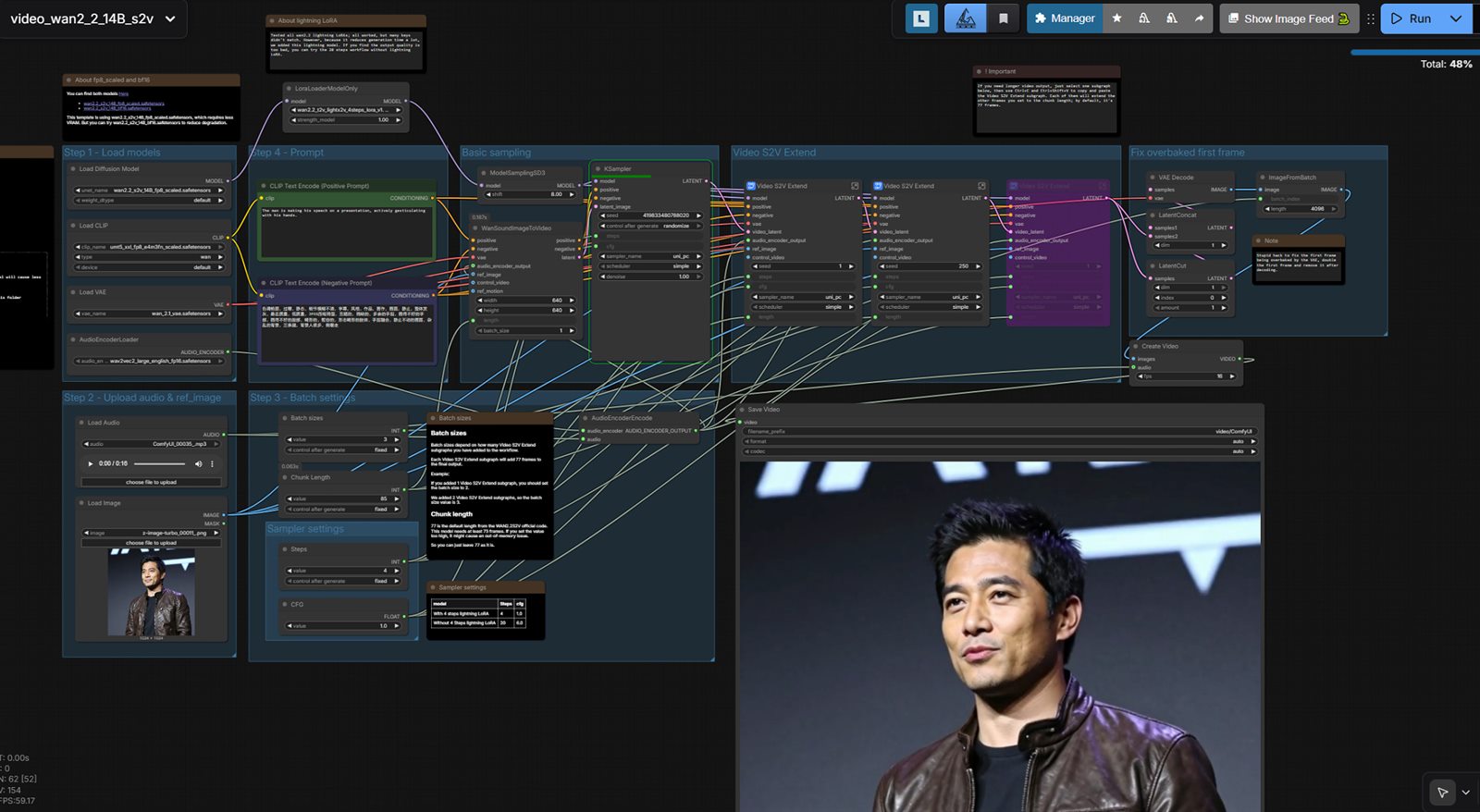

Lokaler/freier Avatar-Pfad (optional)

Offline- oder selbstgehosteter Workflow für sprechende Porträts.

So geht's:

- Bereiten Sie die lokale Umgebung vor (GPU-Treiber, Python-Umgebung, Modellressourcen).

- Führen Sie zunächst einen Basis-Workflow in LivePortrait oder SadTalker aus.

- Verwenden Sie ComfyUI-Vorlagen, wenn Sie wiederverwendbare diagrammbasierte Iterationen wünschen.

- Speichern Sie Arbeitsvoreinstellungen für Auflösung, Bildrate und Audiosynchronisierung.

Qualitätsprüfungen:

- Überprüfen Sie die VRAM-Nutzung vor Batch-Ausführungen.

- Bewahren Sie Quellressourcen für wiederholte Ausführungen in einer vorhersehbaren Ordnerstruktur auf.

- Versionieren Sie Ihren Workflow im JSON-Format, damit die Ergebnisse reproduzierbar sind.

Werkzeuge:

LivePortrait

,

SadTalker

,

ComfyUI

-

Bearbeiten, beschriften und exportieren

Für die Plattform geeignetes Video mit Untertiteln und Tempo, das auf die Aufbewahrung abgestimmt ist.

So geht's:

- Verkürzen Sie Pausen und kürzen Sie die ersten 0,3–0,8 Sekunden, um schneller zu beginnen.

- Fügen Sie eingebrannte Untertitel mit hohem Kontrast und großer, für Mobilgeräte geeigneter Größe hinzu.

- Fügen Sie B-Rolls, Screenshots oder Texthinweise zur Hervorhebung ein.

- Exportieren Sie separate Varianten für Shorts/Reels/TikTok und Querformat-Feeds.

Qualitätsprüfungen:

- Überprüfen Sie die ersten 3 Sekunden: klarer Haken, lesbarer Text, sofortige Bewegung.

- Überprüfen Sie die Timing-Drift der Untertitel bei schnellen Phrasen.

- Bestätigen Sie die endgültigen sicheren Ränder, damit der Text nicht von der Plattform-Benutzeroberfläche ausgeblendet wird.

Werkzeuge:

Descript ,

CapCut

,

VEED