Alternativen zu Gemma 2

Vergleiche Gemma 2 mit ähnlichen lokalen Modellen nach VRAM-Bedarf, Qualität und Lizenzbedingungen.

Die Übersicht hilft dir, Gemma-2-Alternativen für private Inferenz, Assistenz-Workflows und API-Ersatz zu wählen.

Details laut Anbieter.

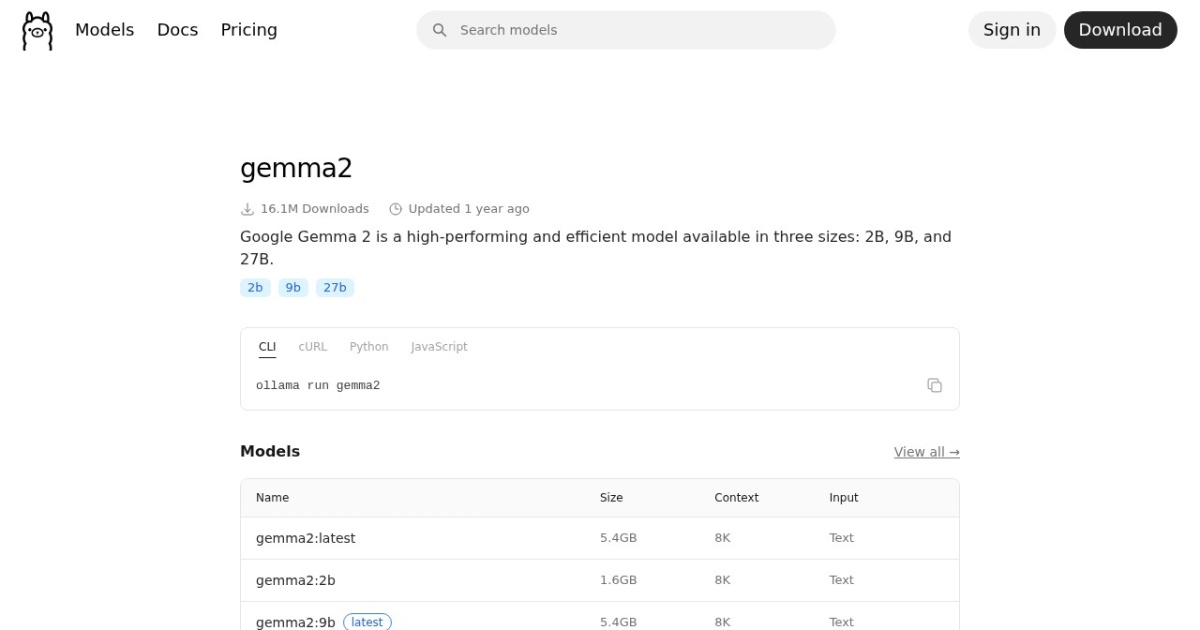

Offizielle Website: https://ollama.com/library/gemma2

YouTube-Kanal: Bei der Prüfung der offiziellen Seite wurde kein offizieller Unternehmenskanal gefunden.

Auf einen Blick

| Preismodell | Kostenlos |

|---|---|

| Seitentyp | Modellfamilie |

| Modellquelle | Eigene Modelle |

| API-Kosten | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. |

| Abo-Kosten | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. |

| Letztes Modell-Update | Details laut Anbieter. |

| Modellgroessen | 2B, 9B, 27B |

| Modellversionen | Gemma 2 launch, Gemma 2 2B, Gemma 2 JPN and Gemma Scope, Gemma 3 announced |

| Verwandtes Modell | Gemma 3 · Gemma 2 vs Gemma 3 |

| Zentraler Unterschied | Details laut Anbieter. |

| Am besten geeignet für | Efficient local chat workloads, Typische Aufgaben laut Anbieter., Typische Aufgaben laut Anbieter. |

| Kategorien | Für Solopreneure , Für kleine Unternehmen , Kostenlose KI-Tools , Entwickler , Lokale LLMs |

Modell-Versionen im Zeitverlauf

Top-Alternativen

- Gemma 3 : Multimodale Gemma-Familie mit 128K Kontext und breiten lokalen Deployments unter den Gemma-Bedingungen.

- Llama 3.1 : Beliebte Alternative für ähnliche Anwendungsfälle.

- Qwen2.5 : Beliebte Alternative für ähnliche Anwendungsfälle.

- Qwen3 8B : Apache-2.0-Open-Weight-8B-Modell mit 128K Kontext, Local-first-Deployment und optionalem Cloud-API-Zugang.

- Phi-3.5 Mini Instruct : Beliebte Alternative für ähnliche Anwendungsfälle.

Vergleichstabelle

| Tool | Preis | Typ | Modellquelle | API | Abo | Vorteile | Nachteile |

|---|---|---|---|---|---|---|---|

| Gemma 2 | Kostenlos | Modellfamilie | Eigene Modelle | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | Klare Stärke im Vergleich.; Nützlich für budgetbewusste lokale Inferenz | Vor dem Einsatz prüfen.; Größere Varianten können begrenzten VRAM weiterhin stark belasten |

| Gemma 3 | Kostenlos | Modellfamilie | Eigene Modelle | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | Mehrere Modellgrößen decken ein breites Spektrum an Hardwareprofilen ab; Long-Context-Unterstützung für umfangreiche Dokumentaufgaben | Nicht mehr der neueste Gemma-Zweig für aktuelle Evaluierungen; Individuelle Lizenzbedingungen erhöhen den Compliance-Aufwand |

| Llama 3.1 | Kostenlos | Modellfamilie | Eigene Modelle | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | Starkes Qualitäts-zu-Größe-Verhältnis für lokale Nutzung; Funktioniert gut bei allgemeinen Assistentenaufgaben | Größere Varianten benötigen deutlich mehr VRAM; Vor dem Einsatz prüfen. |

| Qwen2.5 | Kostenlos | Modellfamilie | Eigene Modelle | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | Starke mehrsprachige Qualität über verschiedene Aufgaben; Skaliert von kleinen bis zu größeren lokalen Deployments | Größere Varianten benötigen deutliche VRAM-Reserven; Der Laufzeitkontext erfordert weiterhin sorgfältiges Tuning |

| Qwen3 8B | Kostenlos | Modellfamilie | Eigene Modelle | API-Kosten laut Anbieter (Details auf offizieller Preisseite). | Abo-Kosten abhängig vom gewählten Tarif. | Apache-2.0-Lizenz unterstützt breite kommerzielle Nutzung; 128K Kontext ist praktisch für Multi-Dokument-Aufgaben | Erfordert lokales Deployment und grundlegende Kenntnisse im Modellbetrieb; Reine Kernmodellreihe ohne Bildverstehen. |

| Phi-3.5 Mini Instruct | Kostenlos | Modellfamilie | Eigene Modelle | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | MIT-Lizenz ist für kommerzielle Nutzung unkompliziert; Klare Stärke im Vergleich. | Bei komplexen Denkaufgaben schwächer als größere Spitzenmodelle; Reine Textvariante in diesem Stand |