Alternativen zu Llama 3.1

Vergleiche Llama 3.1 mit ähnlichen lokalen LLMs nach Qualität, Ressourceneinsatz und Lizenz.

Hier findest du Llama-3.1-Alternativen für private Assistenz, Coding und interne Wissensaufgaben.

Details laut Anbieter.

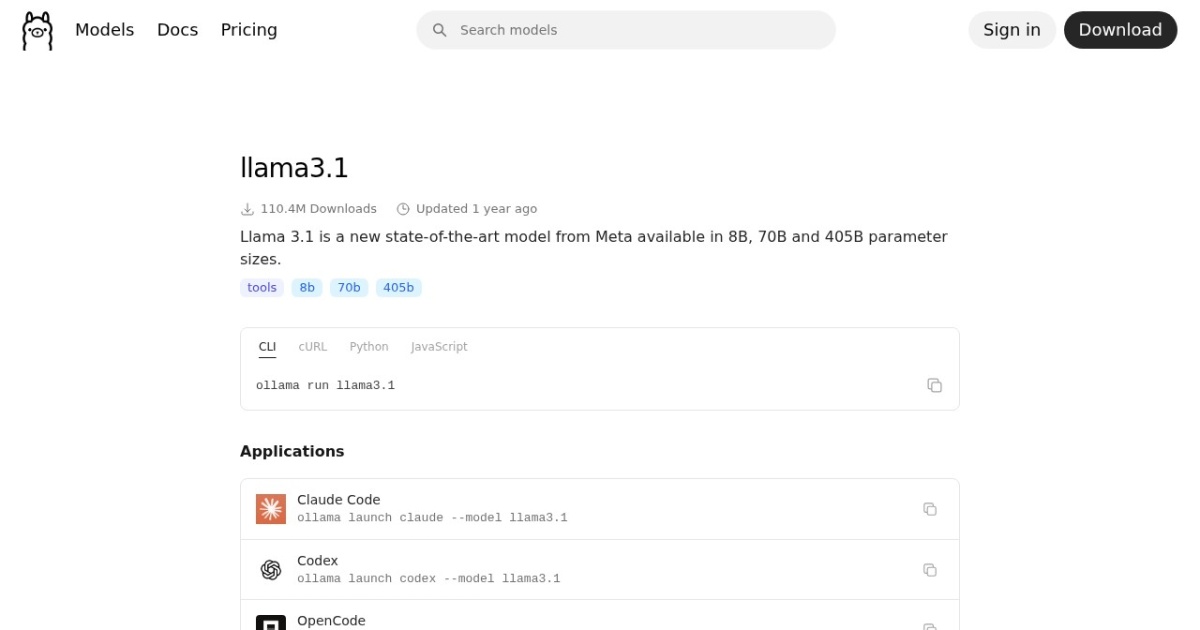

Offizielle Website: https://ollama.com/library/llama3.1

YouTube-Kanal: Bei der Prüfung der offiziellen Seite wurde kein offizieller Unternehmenskanal gefunden.

Auf einen Blick

| Preismodell | Kostenlos |

|---|---|

| Seitentyp | Modellfamilie |

| Modellquelle | Eigene Modelle |

| API-Kosten | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. |

| Abo-Kosten | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. |

| Letztes Modell-Update | Details laut Anbieter. |

| Modellgroessen | 8B, 70B, 405B |

| Modellversionen | Llama 3 launch, Llama 3.1 release, Llama 3.3 release, Ollama library refresh, Llama 4 announcement |

| Am besten geeignet für | Typische Aufgaben laut Anbieter., Zusammenfassungs- und Entwurfsaufgaben, Local-first-Prototyping mit Ollama |

| Kategorien | Für Solopreneure , Für kleine Unternehmen , Kostenlose KI-Tools , Lokale LLMs |

Modell-Versionen im Zeitverlauf

Release-Meilensteine von Llama 3.1

2024-04-18

2024-07-23

2024-12-06

2025-02-22

2025-04-05

Top-Alternativen

- Qwen2.5 : Beliebte Alternative für ähnliche Anwendungsfälle.

- DeepSeek-R1 : Auf Denkaufgaben fokussierte Open-Weight-Familie mit MIT-Kernlizenz und kleineren Distill-Varianten.

- Gemma 2 : Beliebte Alternative für ähnliche Anwendungsfälle.

Vergleichstabelle

| Tool | Preis | Typ | Modellquelle | API | Abo | Vorteile | Nachteile |

|---|---|---|---|---|---|---|---|

| Llama 3.1 | Kostenlos | Modellfamilie | Eigene Modelle | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | Starkes Qualitäts-zu-Größe-Verhältnis für lokale Nutzung; Funktioniert gut bei allgemeinen Assistentenaufgaben | Größere Varianten benötigen deutlich mehr VRAM; Vor dem Einsatz prüfen. |

| Qwen2.5 | Kostenlos | Modellfamilie | Eigene Modelle | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | Starke mehrsprachige Qualität über verschiedene Aufgaben; Skaliert von kleinen bis zu größeren lokalen Deployments | Größere Varianten benötigen deutliche VRAM-Reserven; Der Laufzeitkontext erfordert weiterhin sorgfältiges Tuning |

| DeepSeek-R1 | Kostenlos | Modellfamilie | Eigene Modelle | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | MIT-Kernlizenz ist kommerziell gut nutzbar; Starke Ausrichtung auf logisches Denken bei analytischen Aufgaben | Vor dem Einsatz prüfen.; Die Distill-Lizenz kann je nach Upstream-Modellherkunft variieren |

| Gemma 2 | Kostenlos | Modellfamilie | Eigene Modelle | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | Klare Stärke im Vergleich.; Nützlich für budgetbewusste lokale Inferenz | Vor dem Einsatz prüfen.; Größere Varianten können begrenzten VRAM weiterhin stark belasten |