Alternativen zu Qwen2.5 Coder

Vergleiche Qwen2.5 Coder mit ähnlichen Coding-Modellen nach Codequalität, Kontext und Kosten.

Die Seite hilft dir, Alternativen für lokale und API-basierte Entwickler-Workflows auszuwählen.

Details laut Anbieter.

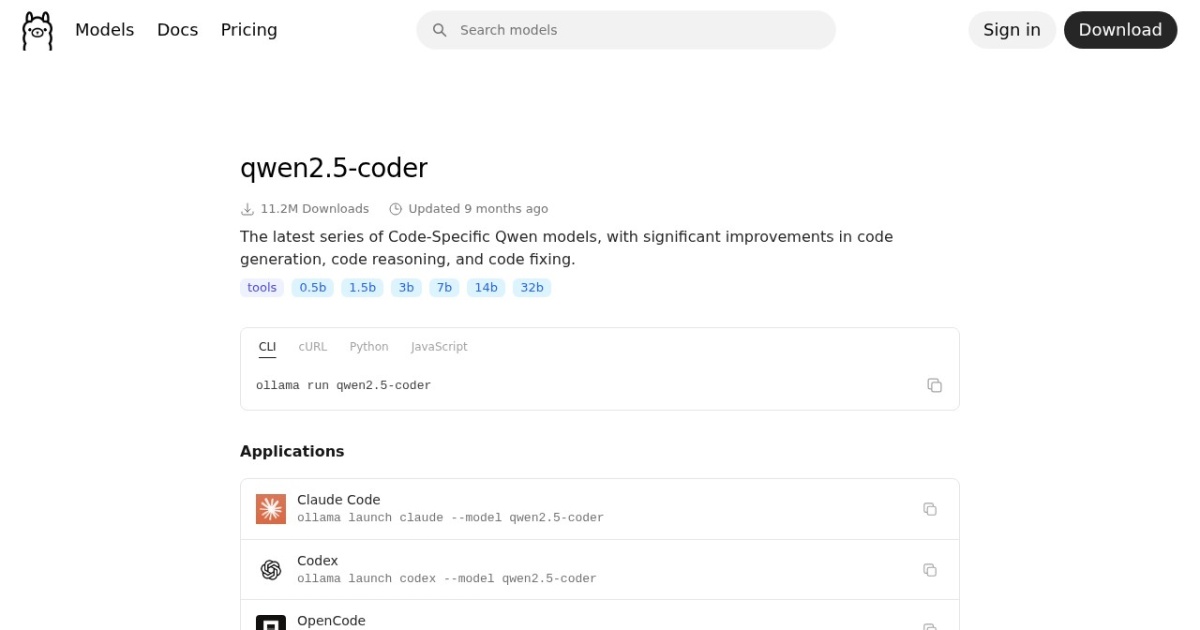

Offizielle Website: https://ollama.com/library/qwen2.5-coder

YouTube-Kanal: Bei der Prüfung der offiziellen Seite wurde kein offizieller Unternehmenskanal gefunden.

Auf einen Blick

| Preismodell | Kostenlos |

|---|---|

| Seitentyp | Modellfamilie |

| Modellquelle | Eigene Modelle |

| Preisspanne | Kostenlos (offene Modellgewichte) |

| API-Kosten | - |

| Abo-Kosten | - |

| Letztes Modell-Update | Details laut Anbieter. |

| Modellgroessen | 0.5B, 1.5B, 3B, 7B, 14B, 32B |

| Modellversionen | Qwen2.5-Coder release, Ollama library refresh |

| Am besten geeignet für | Lokale Unterstützung bei Coding und Debugging, Unterstützung bei Refactoring und Code-Review, Self-hosted Entwicklungsagenten-Workflows |

| Kategorien | Für Solopreneure , Für kleine Unternehmen , Kostenlose KI-Tools , Entwickler |

Modell-Versionen im Zeitverlauf

Top-Alternativen

- GLM-4.7-Flash : Leichter GLM-4.7-Zweig mit Fokus auf schnelle Programmierung, logisches Denken und Generierung mit langem Kontext.

- Phi-3 Mini : Beliebte Alternative für ähnliche Anwendungsfälle.

- DeepSeek-R1 : Auf Denkaufgaben fokussierte Open-Weight-Familie mit MIT-Kernlizenz und kleineren Distill-Varianten.

- Goose : Beliebte Alternative für ähnliche Anwendungsfälle.

Vergleichstabelle

| Tool | Preis | Typ | Modellquelle | Spanne | API | Abo | Vorteile | Nachteile |

|---|---|---|---|---|---|---|---|---|

| Qwen2.5 Coder | Kostenlos | Modellfamilie | Eigene Modelle | Kostenlos (offene Modellgewichte) | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | Strong coding-oriented instruction following; Klare Stärke im Vergleich. | Larger variants may spill on lower-VRAM cards; Vor dem Einsatz prüfen. |

| GLM-4.7-Flash | Kostenlos | Modellfamilie | Eigene Modelle | Kostenlos (offene Modellgewichte) | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | Klare Stärke im Vergleich.; Besseres Geschwindigkeits-/Effizienzprofil als große Flagship-Stacks | Die Ausgabequalität erfordert weiterhin Prompt-Disziplin und Qualitätssicherung; Tooling-/Runtime-Support kann kurz nach neuen Releases hinterherhinken |

| Phi-3 Mini | Kostenlos | Modellfamilie | Eigene Modelle | Kostenlos (offene Modellgewichte) | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | Schnell auf schwächerer lokaler Hardware; Geringerer VRAM-Bedarf als größere Modellfamilien | Niedrigere Leistungsobergrenze bei komplexen Aufgaben für logisches Denken; Kann bei nuancierten Prompts hinter größeren Modellen zurückbleiben |

| DeepSeek-R1 | Kostenlos | Modellfamilie | Eigene Modelle | Kostenlos (offene Modellgewichte) | Keine verpflichtenden API-Kosten für lokale/selbst gehostete Nutzung. | Kein verpflichtendes Abo für den Zugriff auf das Basismodell. | MIT-Kernlizenz ist kommerziell gut nutzbar; Starke Ausrichtung auf logisches Denken bei analytischen Aufgaben | Vor dem Einsatz prüfen.; Die Distill-Lizenz kann je nach Upstream-Modellherkunft variieren |

| Goose | Kostenlos | Open-Source-Projekt | Drittanbieter-Modelle | Kostenlos (Open Source) | Es ist kein separater oeffentlicher API-Preis genannt; der Zugang scheint an Tarif oder gehostete Nutzung gebunden zu sein. | Die Abo-Kosten folgen der oben gezeigten Tarifspanne. | Klare Stärke im Vergleich.; Klare Stärke im Vergleich. | Vor dem Einsatz prüfen.; Vor dem Einsatz prüfen. |