Alternativas a Ministral 3 8b

Compara modelos compactos para inferencia local y APIs económicas, priorizando latencia, memoria y calidad final.

Compara modelos compactos para inferencia local y APIs económicas, priorizando latencia, memoria y calidad final.

En esta página comparamos las alternativas a Ministral 3 8B con detalle de precio, ventajas, limitaciones y mejor encaje para distintos flujos de trabajo.

Ministral 3 8B es una opción práctica para este caso de uso, con ventajas y límites que conviene validar en tu flujo real.

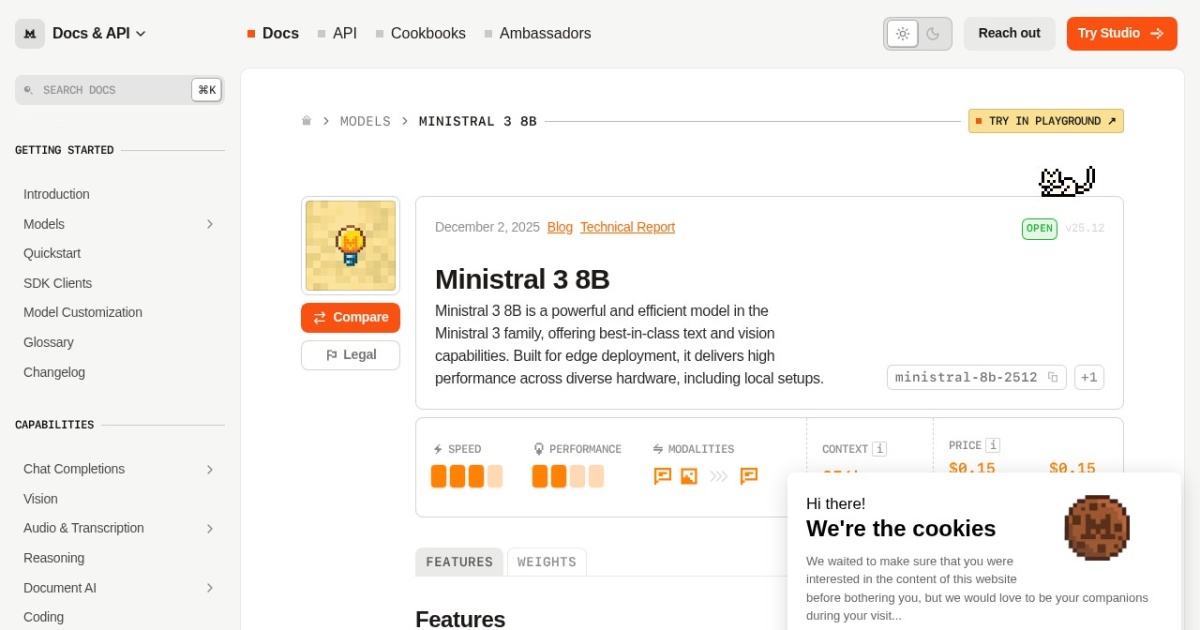

Sitio oficial: https://docs.mistral.ai/models/ministral-3-8b-25-12/

Canal de YouTube: No se encontró un canal oficial de la empresa en la revisión de la página oficial.

Resumen rápido

| Modelo de precio | Gratis |

|---|---|

| Tipo de página | Familia de modelos |

| Origen del modelo | Modelos propios |

| Costo de API | Sin costo obligatorio de API para uso local/autohospedado. |

| Costo de suscripción | Sin suscripción obligatoria para acceso al modelo base. |

| Última actualización del modelo | 2025-12-02 (Mistral changelog release entry). |

| Tamaños de pesos del modelo | 8B |

| Mejor para | Resumen y extracción de documentos largos, Workflows privados de asistentes locales, Solopreneurs creando automatizaciones internas repetibles |

| Categorías | para solopreneurs , para pequeñas empresas , herramientas de IA gratis , Automation , llm locales |

Alternativas destacadas

- Mistral Small 4 : Modelo híbrido abierto de Mistral que combina razonamiento, código, OCR y transcripción en una sola familia con contexto de 256K.

- Qwen3 8B : Modelo open-weight 8B bajo Apache-2.0 con contexto de 128K, despliegue local-first y acceso opcional a API cloud.

- gpt-oss-20b : Alternativa popular para casos de uso similares.

- Phi-3.5 Mini Instruct : Modelo pequeño con licencia MIT y contexto largo, optimizado para uso local y en dispositivo.

Notas

Compara modelos compactos para inferencia local y APIs económicas, priorizando latencia, memoria y calidad final.

En esta página comparamos las alternativas a Ministral 3 8B con detalle de precio, ventajas, limitaciones y mejor encaje para distintos flujos de trabajo.

Tabla comparativa

| Herramienta | Precio | Tipo | Origen del modelo | Costo API | Suscripción | Pros | Contras |

|---|---|---|---|---|---|---|---|

| Ministral 3 8B | Gratis | Familia de modelos | Modelos propios | Sin costo obligatorio de API para uso local/autohospedado. | Sin suscripción obligatoria para acceso al modelo base. | La licencia Apache-2.0 tiene baja fricción para proyectos comerciales; Ventana de contexto muy larga para grandes conjuntos documentales | Las ejecuciones de contexto largo pueden aumentar memoria y latencia; Requiere autohospedaje y disciplina operativa |

| Mistral Small 4 | Gratis | Familia de modelos | Modelos propios | Precio API publicado por el proveedor (consulta detalle oficial). | Costo de suscripción según plan del proveedor. | Ventaja destacada del proveedor.; Ventaja destacada del proveedor. | Desventaja a validar según tu caso.; Los lanzamientos recientes pueden tener soporte desigual en runtimes al principio |

| Qwen3 8B | Gratis | Familia de modelos | Modelos propios | Precio API publicado por el proveedor (consulta detalle oficial). | Costo de suscripción según plan del proveedor. | La licencia Apache-2.0 permite uso comercial amplio; El contexto de 128K es práctico para tareas con múltiples documentos | Requiere despliegue local y fundamentos de operación de modelos; Línea principal de modelo solo texto |

| gpt-oss-20b | Gratis | Familia de modelos | Modelos propios | Sin costo obligatorio de API para uso local/autohospedado. | Sin suscripción obligatoria para acceso al modelo base. | Ventaja destacada del proveedor.; Ventaja destacada del proveedor. | Desventaja a validar según tu caso.; Desventaja a validar según tu caso. |

| Phi-3.5 Mini Instruct | Gratis | Familia de modelos | Modelos propios | Sin costo obligatorio de API para uso local/autohospedado. | Sin suscripción obligatoria para acceso al modelo base. | La licencia MIT es simple para uso comercial; Huella reducida frente a modelos locales más grandes | Más débil en razonamiento complejo que modelos de frontera más grandes; Variante solo texto para este checkpoint |